来源:米伽未来研究所2025

《基础智能体的进步与挑战研究报告:从类脑智能到进化、协作和安全系统》是一份由Bang Liu等多位学者共同完成的264页全面研究报告。该报告由蒙特利尔大学、香港科技大学、斯坦福大学等20多家国际知名研究机构联合发布于2025年3月31日。

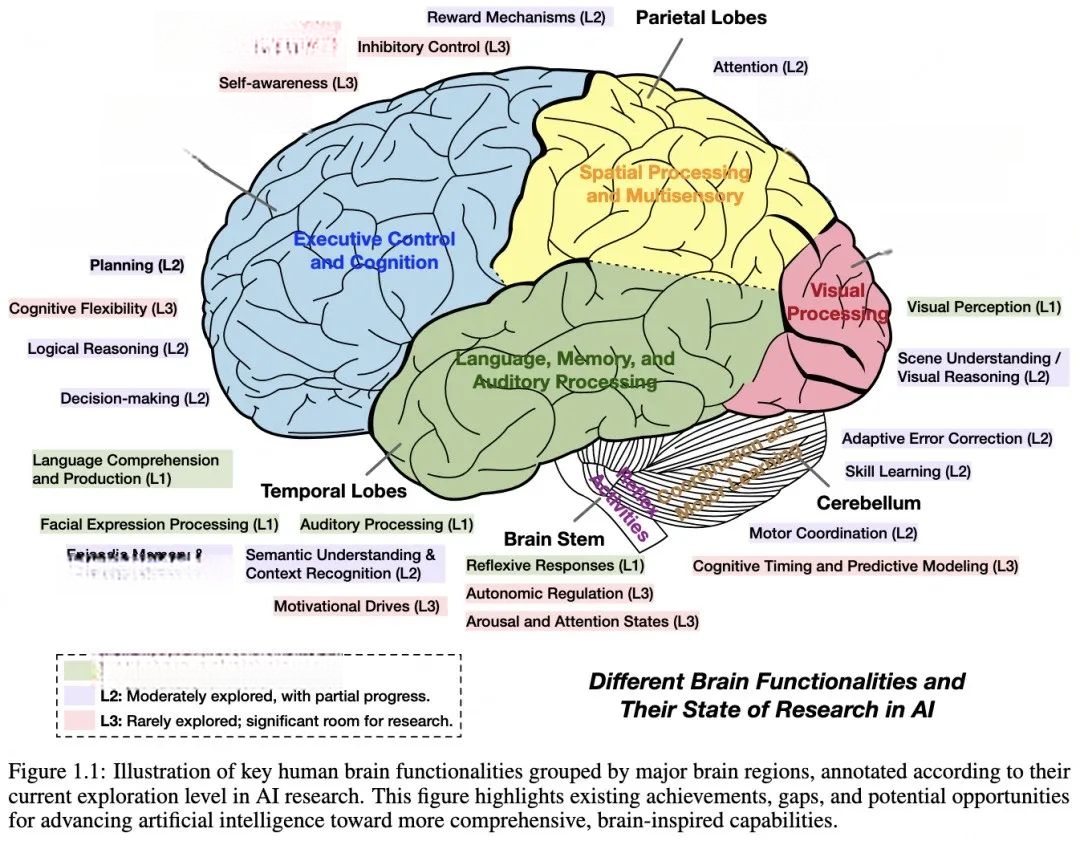

报告系统性地探讨了基于大型语言模型(LLMs)的智能体发展,分为四大部分:一是模块化智能体设计,借鉴人脑功能结构,包括认知、感知和行动模块;二是智能体自我完善机制,涵盖自主学习、自我反思和优化策略;三是多智能体协作与进化系统,研究集体智能与社会性协作模式;四是安全与有益AI构建,提出内在和外在威胁框架及防御策略。报告通过整合认知科学与计算原理,为下一代智能体发展提供全面路线图。

一、从人脑到人工智能:模块化的智能体设计

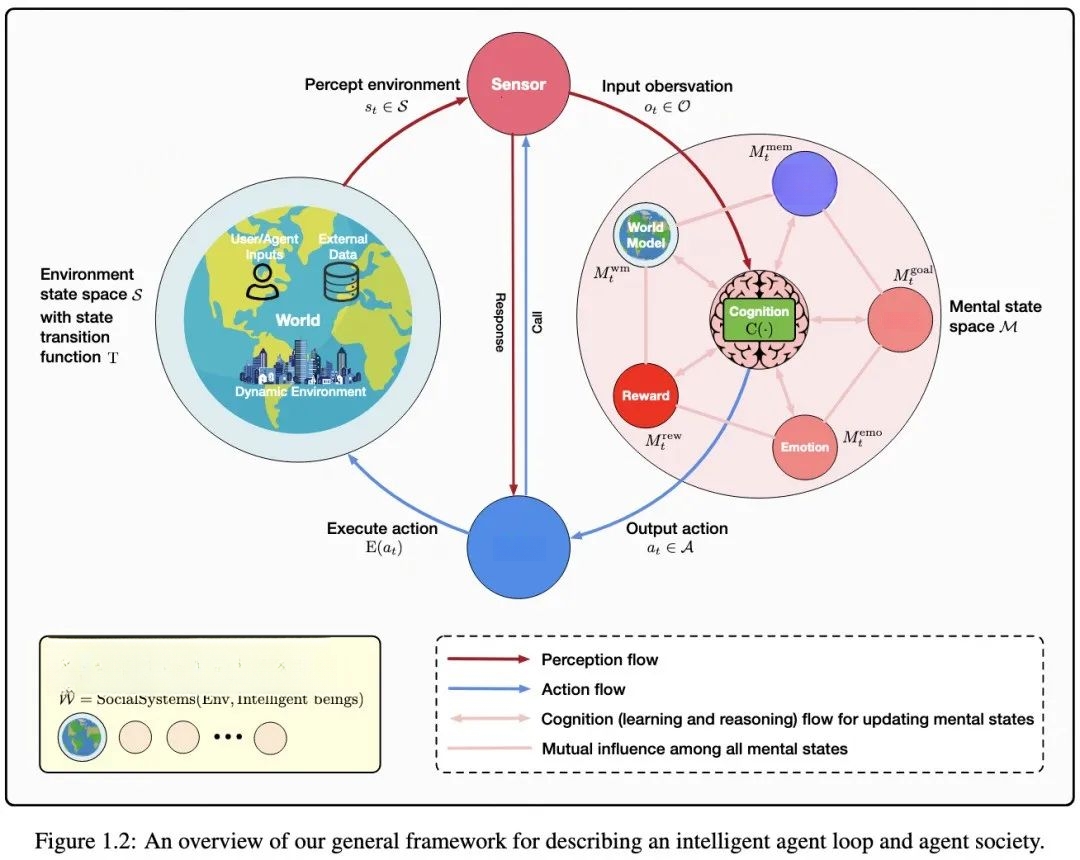

人类大脑是自然界中最复杂、最精妙的系统之一,它通过数十亿神经元的协同工作,实现了感知、记忆、情感、推理和行动等一系列高级认知功能。现代智能体设计正从人脑中汲取灵感,采用模块化的设计方法,将复杂的智能行为分解为互相协作的功能模块。

智能体的核心是认知模块,相当于人类的"大脑",负责处理信息、进行推理和决策。围绕这个核心,现代智能体还包括感知系统(用于接收和解释外部输入)以及行动系统(用于与外部世界交互)。在认知系统内部,又细分为记忆、世界模型、情感、目标和奖励等子系统。

记忆系统是智能体的重要组成部分,类似于人类的短期记忆和长期记忆。短期记忆允许智能体保持对当前任务的关注,而长期记忆则存储过去的经验和知识。研究表明,有效的记忆机制对于智能体的持续学习和适应性至关重要。智能体可以通过回忆过去的经验来指导当前的决策,也可以通过反思已有知识来改进自身能力。

世界模型让智能体能够理解和预测环境中的变化。就像人类基于对物理世界的理解能够预测物体的运动轨迹一样,拥有良好世界模型的智能体可以在采取行动前模拟可能的结果,从而做出更明智的决策。

情感和奖励系统则为智能体提供了动力和目标导向。在人类中,情感和奖励机制深刻影响着我们的决策过程;同样,智能体的奖励系统决定了它们会优先考虑哪些目标和结果。设计适当的奖励机制是确保智能体行为符合人类期望的关键。

二、自我进化:走向持续学习的智能体

与早期需要人工干预才能进步的AI系统不同,现代智能体正在发展自我提升的能力。这种能力让它们能够通过自我反思、经验积累和反馈学习不断完善自己,就像人类通过实践和反思提高技能一样。

自我进化的智能体能够识别自身的局限和错误,然后主动寻求改进的方法。例如,当面对新任务时,智能体可以评估自己的知识或技能是否足够,如果不够,则可以通过学习新知识或改进现有策略来弥补不足。这种能力使智能体不仅能够解决当前问题,还能为未来的挑战做好准备。

记忆系统在自我进化中扮演着关键角色。动态的记忆机制使智能体能够将新知识与已有经验整合,从而在面对复杂或变化的环境时保持高效和相关性。智能体不仅能记住什么有效,还能记住什么无效,避免重复同样的错误。

另一个重要的自我进化机制是自动机器学习(AutoML)和LLM驱动的优化策略。这些技术使智能体能够自动调整参数、优化算法或甚至重新设计自身架构,以适应新的任务需求或环境变化。随着这些技术的发展,我们可以期待看到具有真正持续学习能力的智能体系统,它们能够随着时间的推移而变得越来越智能和有用。

三、集体智慧:多智能体系统的协作与进化

单个智能体的能力再强大,也难以应对现实世界中的复杂挑战。而多智能体系统通过集体协作,能够解决单个智能体无法解决的复杂问题。这些系统由多个智能体组成,每个智能体可能具有不同的专长和职责,通过协调和合作实现共同目标。

多智能体系统的结构可以从简单的层级结构到复杂的网络拓扑,反映了不同的协作方式和决策过程。在层级结构中,高层智能体负责决策和协调,而低层智能体执行具体任务;在更平等的网络结构中,智能体之间通过对等协商达成共识。

智能体之间的通信是协作的基础。早期的多智能体系统使用预定义的协议进行简单通信,而现代系统则采用更灵活、更类似人类的通信方式。通过自然语言沟通,智能体可以交换信息、协商策略、分配任务,甚至互相学习。这种通信能力使多智能体系统能够应对不确定性和变化,就像人类团队通过沟通来适应新情况。

多智能体系统的应用范围广泛,从机器人协作到医疗诊断,再到科学研究。例如,在医疗领域,不同专长的智能体可以协作分析病人数据、提出诊断意见,并设计治疗方案;在科学研究中,多智能体系统可以自主设计实验、收集和分析数据,甚至提出新的科学假设。

随着技术的发展,多智能体系统的社会性也在增强。这些系统开始展现出类似人类社会的特征,如角色分化、规范形成和社会学习。这种社会性不仅使系统更加高效,还增强了与人类的协作能力,为人机共同解决复杂问题创造了可能。

四、安全与伦理:构建值得信任的AI系统

随着智能体在我们生活中扮演越来越重要的角色,确保它们的安全性和可靠性变得至关重要。研究报告提出了一个全面的安全框架,将智能体面临的威胁分为内在威胁和外在威胁两大类。

内在威胁源于智能体本身的架构,包括核心语言模型("大脑")以及感知和行动模块中的漏洞。例如,语言模型可能对某些输入产生不适当的响应,或者感知模块可能误解环境信息,导致错误的决策。这些威胁可能导致智能体表现出意外或有害的行为,即使没有恶意攻击也会如此。

外在威胁则来自智能体与记忆系统、其他智能体以及更广泛环境的交互中。恶意攻击者可能尝试"越狱"(jailbreaking)智能体,绕过其安全限制;或通过"提示注入"(prompt injection)操纵智能体执行有害动作。随着智能体能力的增强,这些威胁的潜在影响也在扩大。

为应对这些挑战,研究人员正在开发各种防御机制。这些机制包括提高模型本身的鲁棒性,增强对有害指令的检测能力,以及实施更严格的访问控制和监控。此外,"超级对齐"(superalignment)技术也在研究中,旨在确保更强大的AI系统仍然能够与人类价值观保持一致。

安全与能力之间存在复杂的关系,即所谓的"AI安全扩展定律"。随着智能体能力的提升,其潜在风险也在增加,这要求我们在追求更强大AI的同时,同步加强安全措施。构建安全、有益的AI系统不仅是技术挑战,也是伦理挑战,需要多学科合作和深思熟虑的设计。

五、未来展望:智能体技术的发展方向

智能体技术正处于快速发展阶段,未来几年将可能见证许多令人兴奋的突破。以下是几个可能的发展方向:

更强的跨域整合能力:未来的智能体将能够更无缝地整合视觉、语言、推理等多种能力,实现真正的多模态智能。这种整合将使智能体能够更全面地理解和交互环境,就像人类同时使用多种感官来感知世界一样。

更深层次的自主学习:智能体将发展出更强的自我反思和学习能力,能够从少量经验中快速学习,并将知识迁移到新领域。这种能力将使智能体更加适应性强,能够在变化的环境中保持高效。

更复杂的社会协作:多智能体系统将展现出更复杂的协作模式,形成类似人类社会的结构和规范。这些系统将能够处理更复杂的任务,并与人类形成更有效的协作关系。

更强的安全保障:随着对AI安全重要性的认识增强,我们将看到更先进的安全机制被开发出来,确保即使是最强大的智能体系统也能保持对人类的友好和有益。

智能体技术的发展将深刻改变我们的生活和工作方式。从个人助手到科学研究,从医疗诊断到教育培训,智能体将在各个领域发挥越来越重要的作用。通过将认知科学的洞见与计算原理相结合,我们有可能创造出既强大又能与人类和谐共处的智能系统。

在这个充满可能性的未来,关键是要确保技术发展与道德考量并重,将人类价值观和需求置于核心位置。只有这样,智能体技术才能真正造福人类社会,成为我们解决21世纪复杂挑战的有力工具。

人工智能不再只是工具,而是正在成为我们的伙伴和助手。基础智能体的进步不仅代表了技术的飞跃,也开启了人类与人工智能共同进化的新纪元。通过理解和借鉴人脑的设计原理,发展自我进化的能力,构建协作的多智能体系统,并确保安全和伦理,我们正在迈向一个人类和人工智能协同工作、共同繁荣的未来。

如今,这位横跨产学研各界的三院院士,将其数十年来对AI的思考与实践凝练成最新著作《智能涌现》。本书引发了产学研商各界的广泛关注,并获得了姚期智、雷军、李开复、施瓦布等全球顶尖领袖的联袂推荐。

阅读最新前沿科技趋势报告,请访问欧米伽研究所的“未来知识库”

https://wx.zsxq.com/group/454854145828

截止到3月31日 ”未来知识库”精选的百部前沿科技趋势报告

(加入未来知识库,全部资料免费阅读和下载)

上下滑动查看更多